Vor Kurzem hat Baidu Baike – ein chinesischsprachiger Wikipedia-ähnlicher Dienst – seine robots.txt-Datei aktualisiert – eine Datei, die Suchmaschinen anweist, auf welche Webadressen sie zugreifen können – und Googlebot und Bingbot vollständig daran gehindert, Inhalte der Plattform zu indizieren.

Foto: Shutterstock

Dieser Schritt zeigt Baidus Bemühungen, seine Online-Ressourcen angesichts der wachsenden Nachfrage nach Big Data zur Entwicklung von Modellen und Anwendungen für künstliche Intelligenz (KI) zu schützen.

Nach der Aktualisierung der robots.txt-Datei von Baidu Baike ergab eine Untersuchung des SCMP, dass viele Elemente der Plattform immer noch in den Suchergebnissen von Google und Bing auftauchten, wahrscheinlich aus zuvor archivierten alten Inhalten.

Mehr als zwei Jahre nach der Einführung von ChatGPT durch OpenAI schließen viele der weltweit größten KI-Entwickler Verträge mit Inhaltsherausgebern ab, um auf hochwertige Inhalte für ihre GenAI-Projekte zugreifen zu können.

OpenAI unterzeichnete im Juni einen Vertrag mit dem Time Magazine, um auf das gesamte Archiv des Magazins mit einer über 100-jährigen Geschichte zugreifen zu können.

Cao Phong (laut SCMP)

[Anzeige_2]

Quelle: https://www.congluan.vn/baidu-chan-google-va-bing-thu-thap-noi-dung-truc-tuyen-post309081.html

![[Foto] Ein kurzer Moment der Ruhe für die Rettungstruppe der vietnamesischen Volksarmee](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/a2c91fa05dc04293a4b64cfd27ed4dbe)

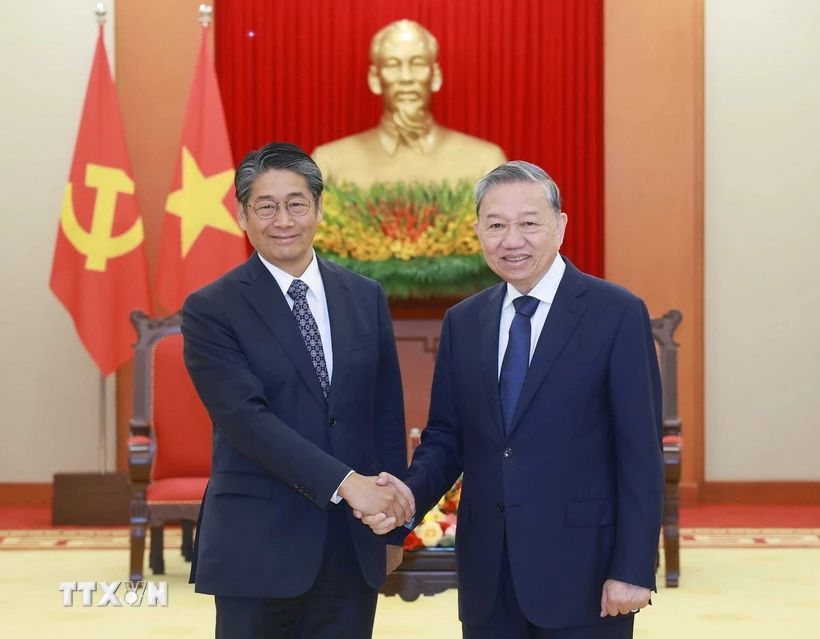

![[Foto] Generalsekretär To Lam empfängt den japanischen Botschafter in Vietnam, Ito Naoki](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3a5d233bc09d4928ac9bfed97674be98)

![[Foto] Ho-Chi-Minh-Stadt beschleunigt die Reparaturarbeiten am Gehweg vor den Feiertagen am 30. April](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/17f78833a36f4ba5a9bae215703da710)

![[Foto] Die Jugend der Hauptstadt übt begeistert Feuerwehr- und Wasserrettungsfähigkeiten](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3f8481675271488abc7b9422a9357ada)

![[Foto] Premierminister Pham Minh Chinh leitet die erste Sitzung des Lenkungsausschusses für regionale und internationale Finanzzentren](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/47dc687989d4479d95a1dce4466edd32)

![[Foto] Premierminister Pham Minh Chinh leitet die Sitzung, nachdem die USA gegenseitige Zölle angekündigt haben](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/ee90a2786c0a45d7868de039cef4a712)

Kommentar (0)