Hình ảnh AI giả mạo hoạt động như thế nào?

Ngày nay AI có mặt ở khắp mọi nơi - ngay cả trong chiến tranh. Các ứng dụng trí tuệ nhân tạo đã được cải thiện rất nhiều trong năm nay và hầu như ai cũng có thể sử dụng các trình tạo AI để tạo ra những hình ảnh trông như thật, ít nhất là từ cái nhìn đầu tiên.

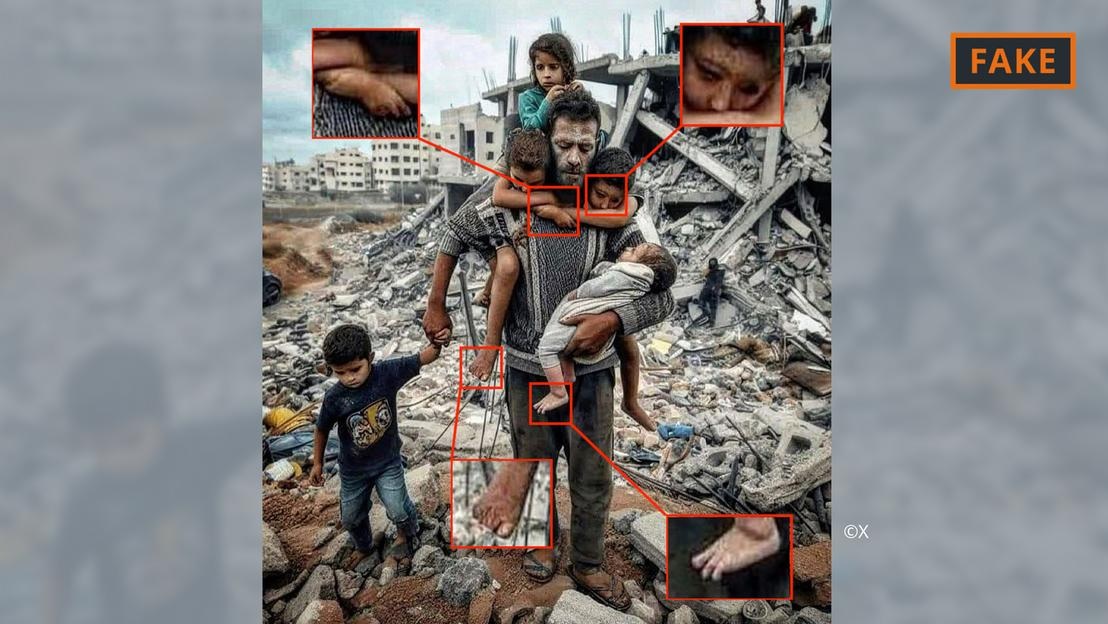

Một bức ảnh giả do AI tạo ra về chiến sự ở Gaza.

Người dùng chỉ cần cung cấp cho các công cụ như Midjourney hoặc Dall-E vài lời gợi ý, bao gồm thông số kỹ thuật và thông tin, để thực hiện việc này. Sau đó, các công cụ AI sẽ chuyển lời nhắc bằng văn bản, thậm chí giọng nói, thành hình ảnh.

Quá trình tạo ảnh này dựa trên cái được gọi là học máy. Ví dụ: Nếu người tạo yêu cầu hiển thị một người đàn ông 70 tuổi đang đi xe đạp, chúng sẽ tìm kiếm cơ sở dữ liệu của mình để ghép các thuật ngữ với hình ảnh.

Dựa trên thông tin có sẵn, thuật toán AI sẽ tạo ra hình ảnh của người đi xe đạp lớn tuổi. Nhờ ngày càng có nhiều thông tin đầu vào và cập nhật kỹ thuật, các công cụ này đã được cải tiến vượt bậc và không ngừng học hỏi.

Tất cả điều này đang được áp dụng cho những hình ảnh liên quan đến cuộc xung đột ở Trung Đông. Chuyên gia AI Hany Farid cho biết, trong một cuộc xung đột mà "cảm xúc rất cao", thông tin sai lệch, bao gồm cả sự lan truyền qua hình ảnh AI, có tác động rất lớn.

Farid, giáo sư phân tích kỹ thuật số tại Đại học California ở Berkeley, nói rằng các trận chiến khốc liệt là nơi sinh sản hoàn hảo để tạo ra và phổ biến nội dung giả mạo, cũng như làm tăng cảm xúc.

Những loại hình ảnh AI về cuộc chiến Israel - Hamas

Các hình ảnh và video được tạo ra với sự trợ giúp của trí tuệ nhân tạo đã làm tăng thêm thông tin sai lệch liên quan đến cuộc chiến ở Ukraine, và điều đó đang tiếp tục xảy ra trong cuộc chiến Israel - Hamas.

Theo các chuyên gia, những hình ảnh AI lan truyền trên mạng xã hội về chiến sự thường có hai loại. Một loại tập trung vào nỗi đau khổ của người dân và khơi dậy sự đồng cảm. Cái còn lại là AI giả mạo nhằm phóng đại sự kiện, qua đó kích động xung đột và bạo lực leo thang.

Ảnh giả AI do tạo ra về người cha và đứa trẻ trong đống đổ nát ở Gaza.

Ví dụ, loại đầu tiên bao gồm bức ảnh ở trên về một người cha cùng năm đứa con trước một đống đổ nát. Nó đã được chia sẻ nhiều lần trên X (trước đây là Twitter) và Instagram, được xem hàng trăm nghìn lần.

Hình ảnh này đã được cộng đồng đánh dấu, ít nhất là trên X, rằng nó là giả mạo. Nó có thể được nhận ra bởi nhiều lỗi và sự không nhất quán khác nhau thường gặp ở hình ảnh AI (xem ảnh trên).

Những điểm bất thường tương tự cũng có thể được nhìn thấy tấm ảnh AI giả mạo đã lan truyền trên X dưới đây, có nội dung cho thấy một gia đình Palestine đang ăn cùng nhau trên đống đổ nát.

Ảnh giả về bữa tiệc của người Palestine do AI tạo ra.

Trong khi đó, một hình ảnh khác cho thấy những đoàn quân vẫy cờ Israel khi họ đi qua một khu định cư đầy những ngôi nhà bị ném bom, thuộc loại thứ hai, được thiết kế để khơi dậy lòng hận thù và bạo lực.

Những hình ảnh AI như vậy đến từ đâu?

Hầu hết các hình ảnh được tạo bằng trí tuệ nhân tạo về xung đột đều được đăng tải trên các nền tảng mạng xã hội, song cũng có ở cả một số nền tảng và tổ chức khác, thậm chí cả ở một số trang tin báo chí.

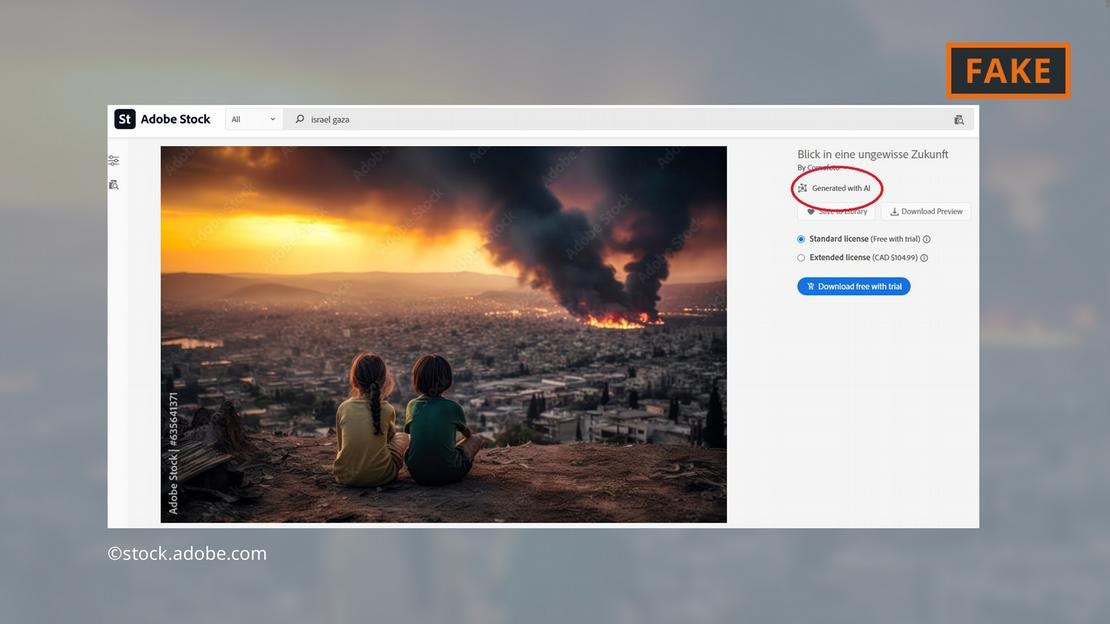

Công ty phần mềm Adobe đã gây xôn xao khi bổ sung các hình ảnh do AI tạo ra vào loạt ảnh stock của mình vào cuối năm 2022. Chúng được dán nhãn tương ứng trong cơ sở dữ liệu.

Adobe hiện cũng cung cấp các hình ảnh AI về cuộc chiến ở Trung Đông để bán - ví dụ như các vụ nổ, người dân biểu tình hoặc những đám khói phía sau Nhà thờ Hồi giáo Al-Aqsa.

Adobe đang cung cấp ảnh do AI tạo ra về chiến sự tại Gaza.

Các nhà phê bình nhận thấy điều này rất đáng ngại khi một số trang web đã tiếp tục sử dụng những hình ảnh mà không gắn nhãn chúng là do AI tạo ra. Ví dụ, hình ảnh nói trên đã xuất hiện trên trang "Newsbreak" mà không có bất kỳ dấu hiệu nào cho thấy nó được tạo ra bằng AI.

Ngay cả Cơ quan Nghiên cứu Nghị viện châu Âu, cơ quan khoa học của Nghị viện châu Âu, cũng đã minh họa một văn bản trực tuyến về cuộc xung đột ở Trung Đông với một tấm ảnh AI từ cơ sở dữ liệu Adobe - đồng thời cũng không gắn nhãn đó là hình ảnh do AI tạo ra.

Đài quan sát truyền thông kỹ thuật số châu Âu đang kêu gọi các nhà báo và chuyên gia truyền thông hết sức cẩn thận khi sử dụng hình ảnh AI, khuyến cáo không nên sử dụng chúng, đặc biệt là khi đề cập đến các sự kiện có thật như chiến tranh ở Gaza.

Hình ảnh AI nguy hại như thế nào?

Nội dung và hình ảnh AI đang lan truyền hẳn khiến người dùng cảm thấy bất an về mọi thứ họ gặp phải trên mạng. Nhà nghiên cứu Farid của UC Berkeley giải thích: "Nếu chúng ta bước vào thế giới này, nơi có thể thao túng hình ảnh, âm thanh và video, thì mọi thứ đều bị nghi ngờ. Vì vậy, bạn sẽ đánh mất niềm tin vào tất cả, kể cả sự thật".

Đó chính xác là những gì đã xảy ra trong trường hợp sau: Một hình ảnh được cho là xác chết cháy đen của một em bé Israel đã được chia sẻ trên MXH X bởi Thủ tướng Israel Benjamin Netanyahu và một số chính khách khác.

Một người có ảnh hưởng chống Israel là Jackson Hinkle sau đó tuyên bố rằng hình ảnh này được tạo ra bằng trí tuệ nhân tạo. Tuyên bố của Hinkle đã được xem hơn 20 triệu lần trên MXH X và dẫn đến các cuộc tranh luận sôi nổi trên nền tảng này.

Cuối cùng, rất nhiều tổ chức và công cụ xác minh đã tuyên bố rằng hình ảnh đó là thật và tuyên bố của Hinkle đã sai. Tuy nhiên, rõ ràng không có công cụ nào có thể giúp người dùng có thể dễ dàng lấy lại niềm tin bị đánh mất của mình!

Hoàng Hải (theo DW)

Nguồn

![[Ảnh] Gặp gỡ những phi công của Phi đội Quyết thắng](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/21/fd30103acbd744b89568ca707378d532)

![[Ảnh] Thủ tướng Phạm Minh Chính tiếp người đứng đầu Cộng hòa Tatarstan thuộc Liên bang Nga](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/21/7877cb55fc794acdb7925c4cf893c5a1)

![[Ảnh] Thủ tướng Phạm Minh Chính tiếp Bộ trưởng Phụ trách giao thông Pháp](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/21/aa649691f85546d59c3624b1821ab6e2)

Bình luận (0)