Эксперты сравнивают ИИ с «машинами», созданными инженерами-технологами, поведение которых имитирует поведение человека и все больше приближается к настоящему интеллекту.

Если ИИ не будет разрабатываться и контролироваться этично, общество может столкнуться со многими последствиями.

ИИ может стать причиной гендерной и этнической дискриминации, если будет создан на основе предвзятых данных. ИИ может заменить многие рабочие места, что создаст серьезную проблему для рынка труда. Людям с ограниченными возможностями, людям, которые редко пользуются технологиями, представителям этнических меньшинств... нужна поддержка, чтобы они не остались позади в процессе доступа к интегрированным услугам ИИ.

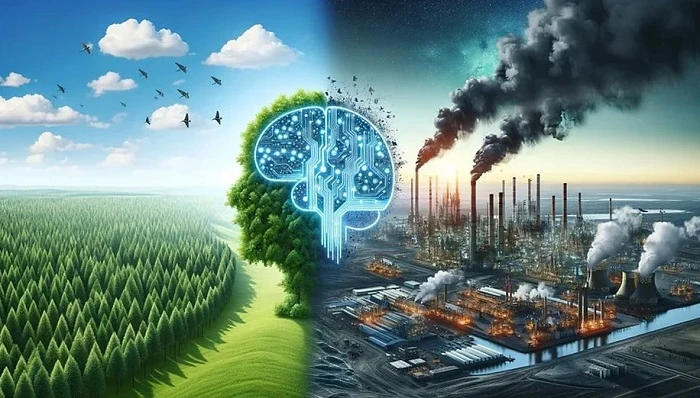

Развитие ИИ также создаст определенные проблемы для окружающей среды и ресурсов. Создание и обслуживание центров обработки данных, инфраструктуры облачных вычислений и суперкомпьютеров требует огромных затрат электроэнергии и воды, а также значительного пространства для размещения оборудования.

Поскольку ИИ проникает в такие важные сферы, как здравоохранение, какова будет ответственность за ошибки в диагностике и лечении? Безопасность информации о пациентах в частности, защита персональных данных в целом, а также обеспечение точности данных — все это вопросы, вызывающие особую озабоченность...

Вышеуказанные риски актуальны не только для Вьетнама, но и для всего мира. Поэтому разработка и применение ИИ должны быть тщательно просчитаны и сопровождаться соответствующими механизмами управления и навигации.

Этика ИИ требует, чтобы лица и организации, участвующие в разработке ИИ, несли ответственность за проектирование, эксплуатацию и использование этой «машины» прозрачным, справедливым и безопасным образом как для пользователей, так и для общества. В то же время этика ИИ также подчеркивает роль мирового и национального сообщества в устранении последствий воздействия ИИ на жизнь.

|

| Развитие ИИ создает определенные проблемы для окружающей среды и ресурсов. (Иллюстрация) |

Наша партия и государство считают основной целью цифровой трансформации служение людям, ставя людей в центр внимания. Поэтому, помимо продвижения и развития, мы сосредоточились на минимизации нежелательного воздействия на людей в процессе цифровой трансформации.

Национальная ассамблея запросила провести исследование политики поддержки тех, кого затронула промышленная революция 4.0, в процессе внесения поправок в Закон о занятости.

Мы приняли Закон о данных 2024 года, находимся в процессе разработки Закона о защите персональных данных, вносим поправки в Закон о кибербезопасности... с целью содействия контролю рисков, связанных с ИИ.

Агентства и организации политической системы изучают множество решений, которые помогут людям получить более удобный доступ к интеллектуальным административным услугам. Операционная модель Центра услуг государственного управления города Ханой является примером...

Однако главная проблема заключается в том, как найти баланс между продвижением инноваций и контролем этики ИИ. Слишком жесткий контроль может подавить инновации, но слишком слабый контроль может привести к тем же последствиям, о которых уже говорилось.

Кроме того, при одновременной реализации множества стратегий и программ развития науки и техники необходим расчет и сбалансированность, чтобы быть целесообразным в условиях ограниченности ресурсов.

|

| Баланс между стимулированием инноваций и контролем этики ИИ. (Иллюстрация) |

В этом контексте очень важную роль играет активная роль профессиональных объединений, предприятий, научно-исследовательских институтов, общественных организаций и т. д., которые помогают правительству ориентировать развитие ответственного ИИ.

Недавно, 22 марта 2025 года, была создана Национальная ассоциация данных, целью которой является создание сильной экосистемы данных, способствующей развитию цифровой экономики и повышению ценности данных в национальной экономике.

Ранее Вьетнамская ассоциация по программному обеспечению и информационным технологиям (VINASA) создала Комитет по этике искусственного интеллекта. Комитет работает над консультированием органов власти по вопросам разработки этического кодекса поведения в сфере ИИ для компаний, занимающихся разработкой ИИ. В то же время Комитет предложил создать стандартизированный набор данных, требующий от иностранных предприятий, разрабатывающих ИИ во Вьетнаме, соблюдения определенных критериев.

Модель VINASA необходимо тиражировать и поощрять, поскольку очевидно, что этика ИИ — это не только вопрос органов управления, но и требует сотрудничества всего общества.

В долгосрочной перспективе Вьетнаму необходимо рассмотреть возможность создания ответственной стратегии развития ИИ в рамках общей Национальной стратегии развития искусственного интеллекта, обеспечивающей все ценности: справедливость, инклюзивность, прозрачность, безопасность и подотчетность.

Что еще важнее, соблюдение закона является обязательным требованием, требующим от каждого человека и организации глубокой осознанности как в сознании, так и в действиях при разработке и применении ИИ.

Необходимо продолжать совершенствовать правовую систему, чтобы четко определить правовую ответственность, создать механизм рассмотрения нарушений и защиты законных прав заинтересованных сторон в цифровой среде.

Международный опыт также является важной основой для Вьетнама, на которую можно опереться, создавая тем самым подходящую модель управления ИИ. Полная правовая система и эффективный механизм мониторинга помогут контролировать риски и предотвращать злоупотребления технологиями, не препятствуя инновациям. В это время ИИ действительно станет инструментом служения человечеству и содействия социальному прогрессу.

Источник: https://nhandan.vn/dao-duc-ai-thach-thuc-va-huong-di-post873031.html

![[Видео] Институт информации социальных наук отмечает 50-летний юбилей](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/5/8/541d6946f8a14ed3824d7a3edafc652c)

![[Видео] Исследование по устранению дисциплинарных мер, таких как предупреждения перед всей школой и исключение из школы для учащихся](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/5/9/99e24134e0824720b12908a8d6e15e12)

![[Фото] Генеральный секретарь То Лам начинает официальный визит в Россию и принимает участие в праздновании 80-летия Победы над фашизмом](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/5/8/5d2566d7f67d4a1e9b88bc677831ec9d)

![[Фото] Генеральный секретарь То Лам начинает официальный визит в Россию и принимает участие в праздновании 80-летия Победы над фашизмом](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/5d2566d7f67d4a1e9b88bc677831ec9d)

Комментарий (0)