СГГПО

Эксперты «Лаборатории Касперского» поделились своим анализом возможных последствий внедрения искусственного интеллекта (ИИ), особенно потенциальных психологических рисков этой технологии.

|

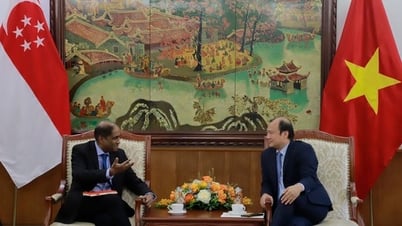

| Г-н Виталий Камлюк рассказывает об искусственном интеллекте |

Виталий Камлюк, директор Глобальной исследовательской и аналитической группы «Лаборатории Касперского» (GReAT) в Азиатско-Тихоокеанском регионе, рассказал, что когда киберпреступники используют ИИ для совершения преступлений, они могут возлагать вину на технологию и чувствовать себя менее ответственными за последствия кибератаки.

«Помимо технологических угроз, создаваемых ИИ, существует также потенциальная психологическая угроза. Распространенный психологический синдром среди киберпреступников известен как «синдром избегания вины». Нападая на прохожих или причиняя им вред, преступники испытывают огромное психологическое давление, становясь свидетелями прямых последствий своих действий. Однако это не относится к киберпреступнику, который крадет и нападает на жертву, которую никогда не видит», — пояснил Камлюк.

Еще одним психологическим побочным эффектом ИИ, который может повлиять на команды по ИТ-безопасности, является «делегирование ответственности». Это происходит по мере того, как все больше процессов и инструментов кибербезопасности автоматизируются и делегируются искусственным нейронным сетям, люди могут чувствовать себя менее ответственными в случае кибератаки, особенно в корпоративной среде.

«С развитием ИИ мы увидели прорывы в технологиях, которые могут синтезировать контент, похожий на тот, что делают люди: от изображений до аудио, видео с дипфейком и даже текстовые разговоры, которые неотличимы от человеческих. Как и большинство технологических прорывов, ИИ — это палка о двух концах. Мы всегда можем использовать его в своих интересах, пока знаем, как устанавливать безопасные правила для этих интеллектуальных машин», — добавил Камлюк.

Источник

![[Фото] Премьер-министр Фам Минь Чинь начинает строительство важной автомагистрали через Тхайбинь и Намдинь](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/12/52d98584ccea4c8dbf7c7f7484433af5)

![[Фото] Премьер-министр Фам Минь Чинь принимает министра международного сотрудничества и внешней торговли Швеции](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/12/ae50d0bb57584fd1bbe1cd77d9ad6d97)

![[Фото] Премьер-министр Фам Минь Чинь работает с Постоянным комитетом провинциального партийного комитета Тхайбиня](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/12/f514ab990c544e05a446f77bba59c7d1)

Комментарий (0)