OpenAI ບໍ່ໄດ້ເປີດເຜີຍຫຼາຍກ່ຽວກັບວິທີການຝຶກອົບຮົມ ChatGPT-4. ຢ່າງໃດກໍຕາມ, ໂດຍທົ່ວໄປແລ້ວຕົວແບບພາສາຂະຫນາດໃຫຍ່ (LLMs) ແມ່ນການຝຶກອົບຮົມກ່ຽວກັບຂໍ້ຄວາມທີ່ດຶງມາຈາກອິນເຕີເນັດ, ບ່ອນທີ່ພາສາອັງກິດແມ່ນພາສາຝຣັ່ງ. ປະມານ 93% ຂອງຂໍ້ມູນການຝຶກອົບຮົມຂອງ ChatGPT-3 ເປັນພາສາອັງກິດ.

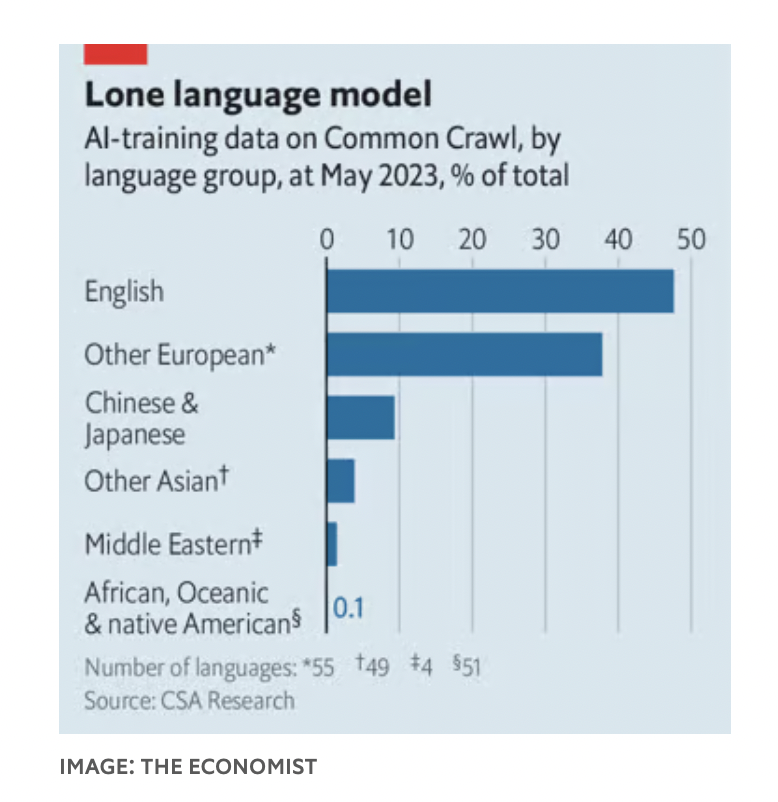

ໃນ Common Crawl, ພຽງແຕ່ຫນຶ່ງໃນຊຸດຂໍ້ມູນທີ່ຮູບແບບ AI ໄດ້ຮັບການຝຶກອົບຮົມ, ພາສາອັງກິດເຮັດໃຫ້ເຖິງ 47% ຂອງ corpus, ກັບພາສາເອີຣົບອື່ນໆເຮັດໃຫ້ເຖິງ 38%. ກົງກັນຂ້າມ, ຈີນແລະຍີ່ປຸ່ນກວມເອົາພຽງແຕ່ 9%.

ການທົບທວນຄືນໂດຍ Nathaniel Robinson, ນັກຄົ້ນຄວ້າຢູ່ມະຫາວິທະຍາໄລ Johns Hopkins, ແລະເພື່ອນຮ່ວມງານຂອງລາວພົບວ່າບັນຫາບໍ່ໄດ້ຈໍາກັດຢູ່ໃນ ChatGPT ດຽວ. LLMs ທັງຫມົດປະຕິບັດໄດ້ດີກັບພາສາ "ຊັບພະຍາກອນສູງ" ບ່ອນທີ່ຂໍ້ມູນການຝຶກອົບຮົມມີຄວາມອຸດົມສົມບູນ, ກ່ວາພາສາ "ຊັບພະຍາກອນຕ່ໍາ" ທີ່ພວກເຂົາຂາດແຄນ.

ນີ້ແມ່ນບັນຫາສຳລັບຜູ້ທີ່ຫວັງຈະນຳ AI ໄປສູ່ບັນດາປະເທດທຸກຍາກເພື່ອປັບປຸງບັນດາຂົງເຂດນັບແຕ່ການສຶກສາເຖິງການຮັກສາສຸຂະພາບ. ດັ່ງນັ້ນ, ນັກຄົ້ນຄວ້າໃນທົ່ວໂລກກໍາລັງເຮັດວຽກເພື່ອເຮັດໃຫ້ AI ຫຼາຍພາສາ.

ເດືອນກັນຍາທີ່ຜ່ານມາ, ລັດຖະບານອິນເດຍໄດ້ເປີດຕົວ chatbot ທີ່ຊ່ວຍໃຫ້ຊາວກະສິກອນປັບປຸງຂໍ້ມູນທີ່ເປັນປະໂຫຍດຈາກລັດ.

Shankar Maruwada ຈາກມູນນິທິ EkStep, ທີ່ບໍ່ຫວັງຜົນກໍາໄລທີ່ຊ່ວຍສ້າງ chatbot, ກ່າວວ່າ bot ເຮັດວຽກໂດຍການລວມເອົາສອງປະເພດຂອງພາສາເຂົ້າກັນ, ແລະຜູ້ໃຊ້ສາມາດສົ່ງຄໍາຖາມເປັນພາສາກໍາເນີດຂອງເຂົາເຈົ້າ. ຄໍາຖາມທີ່ເປັນພາສາກໍາເນີດເຫຼົ່ານີ້ຖືກສົ່ງກັບຊອບແວການແປພາສາເຄື່ອງຢູ່ໃນສະຖານທີ່ຄົ້ນຄ້ວາອິນເດຍ, ເຊິ່ງແປເປັນພາສາອັງກິດກ່ອນທີ່ຈະສົ່ງຕໍ່ໃຫ້ LLM ເພື່ອປະມວນຜົນຄໍາຕອບ. ສຸດທ້າຍ, ຄໍາຕອບຈະຖືກແປເປັນພາສາກໍາເນີດຂອງຜູ້ໃຊ້.

ຂະບວນການນີ້ອາດຈະເຮັດວຽກ, ແຕ່ການແປຄໍາຖາມເຂົ້າໄປໃນພາສາ "ມັກ" ຂອງ LLM ແມ່ນເປັນການແກ້ໄຂ clumsy. ພາສາແມ່ນວິທີການສະທ້ອນວັດທະນະທໍາແລະທັດສະນະຂອງໂລກ. ເອກະສານປີ 2022 ໂດຍ Rebecca Johnson, ນັກຄົ້ນຄວ້າຈາກມະຫາວິທະຍາໄລ Sydney, ພົບວ່າ ChatGPT-3 ໄດ້ຜະລິດຄໍາຕອບກ່ຽວກັບຫົວຂໍ້ຕ່າງໆເຊັ່ນການຄວບຄຸມປືນແລະນະໂຍບາຍການອົບພະຍົບທີ່ປຽບທຽບກັບຄຸນຄ່າຂອງອາເມລິກາທີ່ສະແດງອອກໃນການສໍາຫຼວດມູນຄ່າໂລກ.

ດັ່ງນັ້ນ, ນັກຄົ້ນຄວ້າຈໍານວນຫຼາຍກໍາລັງພະຍາຍາມເຮັດໃຫ້ LLMs ຄ່ອງແຄ້ວໃນພາສາທີ່ໃຊ້ຫນ້ອຍລົງ. ທາງດ້ານເຕັກນິກ, ວິທີການຫນຶ່ງແມ່ນການແກ້ໄຂ tokenization ຂອງພາສາ. ການເລີ່ມຕົ້ນຂອງອິນເດຍທີ່ເອີ້ນວ່າ Sarvam AI ໄດ້ຂຽນ tokenizer ທີ່ດີທີ່ສຸດສໍາລັບພາສາຮິນດູ, ຫຼືຮູບແບບ OpenHathi - LLM ເຫມາະສໍາລັບພາສາ Devanagari (ອິນເດຍ) ທີ່ສາມາດຫຼຸດຜ່ອນຄ່າໃຊ້ຈ່າຍໃນການຕອບຄໍາຖາມໄດ້ຢ່າງຫຼວງຫຼາຍ.

ອີກວິທີຫນຶ່ງແມ່ນເພື່ອປັບປຸງຊຸດຂໍ້ມູນທີ່ LLM ໄດ້ຮັບການຝຶກອົບຮົມ. ໃນເດືອນພະຈິກ, ທີມງານຂອງນັກຄົ້ນຄວ້າທີ່ມະຫາວິທະຍາໄລ Mohamed bin Zayed, ໃນ Abu Dhabi, ໄດ້ປ່ອຍຕົວແບບທີ່ເວົ້າພາສາອາຫລັບສະບັບຫລ້າສຸດທີ່ເອີ້ນວ່າ "Jais." ມັນມີ 1/6th ຈໍານວນຂອງຕົວກໍານົດການຂອງ ChatGPT-3, ແຕ່ໃຫ້ປະສິດທິພາບປຽບທຽບສໍາລັບ Arabic.

Timothy Baldwin, ອະທິການບໍດີມະຫາວິທະຍາໄລ Mohamed bin Zayed, ໃຫ້ຂໍ້ສັງເກດວ່າ, ເຖິງແມ່ນວ່າທີມງານຂອງລາວຈະສ້າງຕົວເລກຂອງຂໍ້ຄວາມພາສາອາຫລັບຫຼາຍ, ແຕ່ຕົວແບບດັ່ງກ່າວຍັງປະກອບມີຂໍ້ຄວາມພາສາອັງກິດບາງອັນ. ແນວຄວາມຄິດບາງຢ່າງແມ່ນຄືກັນໃນທຸກພາສາແລະສາມາດຮຽນຮູ້ໃນພາສາໃດກໍ່ຕາມ.

ວິທີທີສາມແມ່ນການປບັຕົວແບບຫຼັງຈາກພວກເຂົາໄດ້ຮັບການຝຶກອົບຮົມ. ທັງ Jais ແລະ OpenHathi ມີຄູ່ຄໍາຖາມແລະຄໍາຕອບທີ່ສ້າງຂຶ້ນໂດຍມະນຸດ. ດຽວກັນກັບ chatbots ຕາເວັນຕົກ, ເພື່ອປ້ອງກັນຂໍ້ມູນທີ່ບໍ່ຖືກຕ້ອງ.

Ernie Bot, LLM ຂອງ Baidu, ບໍລິສັດເຕັກໂນໂລຢີໃຫຍ່ຂອງຈີນ, ໄດ້ຖືກຄວບຄຸມເພື່ອຈໍາກັດຄໍາເວົ້າທີ່ອາດຈະເຮັດໃຫ້ລັດຖະບານກະທໍາຜິດ. ຕົວແບບຍັງສາມາດຮຽນຮູ້ຈາກຄວາມຄິດເຫັນຂອງມະນຸດ, ບ່ອນທີ່ຜູ້ໃຊ້ໃຫ້ຄະແນນຄໍາຕອບຂອງ LLM. ແຕ່ມັນເປັນການຍາກທີ່ຈະເຮັດສໍາລັບຫລາຍພາສາໃນພາກພື້ນທີ່ພັດທະນາຫນ້ອຍເນື່ອງຈາກຄວາມຕ້ອງການທີ່ຈະຈ້າງຄົນທີ່ມີຄຸນວຸດທິໃນການວິພາກວິຈານວິທີການທີ່ເຄື່ອງຈັກຕອບສະຫນອງ.

(ອີງຕາມນັກເສດຖະສາດ)

ທີ່ມາ

![[ຮູບພາບ] ທ່ານນາຍົກລັດຖະມົນຕີ ຟ້າມມິງຈິ້ງ ເປັນປະທານກອງປະຊຸມລັດຖະບານກັບທ້ອງຖິ່ນກ່ຽວກັບການເຕີບໂຕເສດຖະກິດ](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/2/21/f34583484f2643a2a2b72168a0d64baa)

(0)