SGGPO

Kaspersky trình bày các nguyên tắc đạo đức khi ứng dụng trí tuệ nhân tạo (AI) hoặc học máy (ML) trong quá trình phát triển và sử dụng hệ thống của doanh nghiệp nhằm củng cố cam kết phát triển công nghệ một cách có trách nhiệm và minh bạch.

|

| Kaspersky đã sử dụng thuật toán ML - một tập hợp con của AI trong các giải pháp của doanh nghiệp gần 20 năm qua. |

Khi vai trò của thuật toán AI ngày càng nổi bật trong an ninh mạng, các nguyên tắc trong Sách trắng (White paper) của Kaspersky đã giải thích làm thế nào để doanh nghiệp đảm bảo độ đáng tin cậy của công nghệ AI và hướng dẫn các công ty trong ngành giảm thiểu rủi ro liên quan đến việc sử dụng thuật toán AI/ML.

Việc kết hợp trí tuệ nhân tạo và kiến thức chuyên môn của con người đã giúp các giải pháp của Kaspersky phát hiện và chống lại nhiều mối đe dọa an ninh mạng một cách hiệu quả. Trong đó, ML đóng vai trò quan trọng trong việc tự động phát hiện mối đe dọa và nhận dạng bất thường, đồng thời nâng cao độ chính xác trong việc phát hiện phần mềm độc hại.

Để thúc đẩy sự đổi mới, Kaspersky đã xây dựng các nguyên tắc đạo đức cho việc phát triển và sử dụng AI/ML. Các nguyên tắc này cũng được chia sẻ công khai với toàn ngành với mục đích ngoại giao đa phương nhằm đảm bảo AI được sử dụng đúng đắn để tạo ra một thế giới tốt đẹp hơn.

Nguyên tắc minh bạch thể hiện niềm tin vững chắc của Kaspersky rằng các công ty nên thông báo cho khách hàng của mình về việc công nghệ AI/ML được sử dụng trong các sản phẩm và dịch vụ. Kaspersky tuân thủ nguyên tắc này bằng cách phát triển các hệ thống AI/ML dễ sử dụng nhất có thể, chia sẻ thông tin với các bên liên quan về cách hoạt động của các giải pháp và cách Kaspersky tận dụng công nghệ AI/MI.

Theo Kaspersky, để thuận lợi trong việc phát triển và sử dụng AI/ML cần cân nhắc sáu nguyên tắc sau: sự minh bạch, sự an toàn; kiểm soát của con người; sự riêng tư; cam kết sử dụng cho mục đích an ninh mạng; sự cởi mở đối thoại…

Nguồn

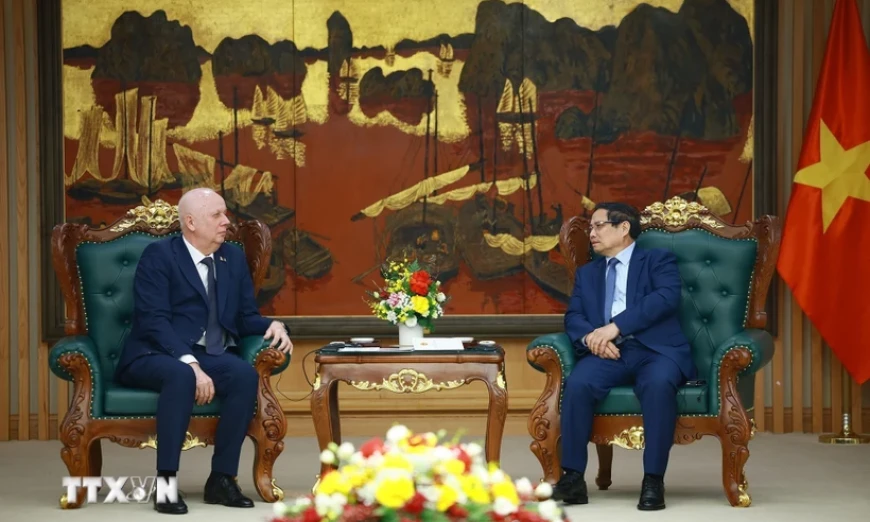

![[Ảnh] Tổng Bí thư Tô Lâm tiếp Đại sứ Liên bang Nga tại Việt Nam](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/2/b486192404d54058b15165174ea36c4e)

![[Ảnh] Đồng chí Khamtay Siphandone - nhà lãnh đạo góp phần vun đắp quan hệ Việt-Lào](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3d83ed2d26e2426fabd41862661dfff2)

![[Ảnh] Thủ tướng Phạm Minh Chính tiếp Tổng Giám đốc Tập đoàn Standard Chartered](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/2/125507ba412d4ebfb091fa7ddb936b3b)

![[Ảnh] Thủ tướng Phạm Minh Chính tiếp Phó Thủ tướng Chính phủ Cộng hòa Belarus Anatoly Sivak](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/2/79cdb685820a45868602e2fa576977a0)

![[Podcast] Bản tin ngày 26/3/2025](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/c3d9c3c48b624fd9af79c13ff9e5c97a)

Bình luận (0)