ロイター通信によると、11月26日に公開された20ページの文書では、AI研究・応用企業は顧客や一般大衆を不正使用から守る形で技術を開発・展開する必要があることに18カ国が同意した。

この合意は拘束力がなく、主にAIシステムを監視して不正使用を検知・防止すること、データを保護すること、ソフトウェアベンダーを審査することなど、一般的な勧告を行っている。

AIの発展は、技術分野での競争と多くの懸念をもたらします。

しかし、米国サイバーセキュリティ・インフラセキュリティ庁のジェン・イースタリー長官は、AIシステムは安全性を最優先にする必要があるとの見解を多くの国が共有していることが重要だと述べた。

「各国が一致団結して、こうした能力は単に機能の魅力や、いかに早く市場に投入できるか、あるいはいかにしてコストを削減するかという競争だけの問題ではないと主張するのは初めてだ」とイースターリー氏はロイター通信に語った。当局者は、このガイドラインは「設計段階で確保すべき最も重要なことはセキュリティであるという合意」を表していると述べた。

この合意は、AIの発展を形作ることを目的とした世界各国政府による一連の取り組みの中で最新のものである。 AI の影響は、業界全体、そして社会全体でますます感じられるようになっています。

この文書は、AIシステムをハッカーの攻撃から保護する方法についての疑問を取り上げており、徹底したセキュリティテストを行った後にのみ新しいモデルをリリースするなどの推奨事項も含まれています。新しいガイドラインは、AIの適切な使用や、こうしたモデルに供給するデータの収集方法といった難しい問題には対処していない。

AIの台頭は、AIが民主的なプロセスを混乱させたり、詐欺を助長したり、大規模な失業を引き起こしたりするなど、さまざまな危害をもたらす可能性があるという懸念を含め、多くの懸念を引き起こしている。

欧州はAI関連の規制制定で米国より先行している。フランス、ドイツ、イタリアも最近、AIの基礎モデルに関して、この分野をどのように規制するかについて合意に達した。

バイデン政権はAI規制について議員に圧力をかけているが、深刻な二極化が進む議会では効果的な規制の可決にほとんど進展が見られない。

ホワイトハウスは10月に新たな大統領令を発令し、国家安全保障を強化しつつ、消費者、労働者、少数派に対するAIのリスクを軽減することを目指した。

[広告2]

ソースリンク

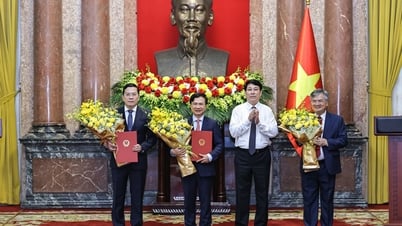

![[写真] ルオン・クオン大統領が大統領府副長官の任命決定を発表](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/501f8ee192f3476ab9f7579c57b423ad)

![[写真] ト・ラム書記長がロシア公式訪問を開始、対ファシズム勝利80周年記念式典に出席](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/5d2566d7f67d4a1e9b88bc677831ec9d)

![[写真] チャン・タン・マン国会議長が第1回国会党大会文書小委員会の会議を主宰](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/72b19a73d94a4affab411fd8c87f4f8d)

![[写真] 事務総長がアゼルバイジャン訪問を終え、ロシア連邦訪問へ出発](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/7a135ad280314b66917ad278ce0e26fa)

![[写真] ファム・ミン・チン首相が民間経済発展政策諮問委員会と会談](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/387da60b85cc489ab2aed8442fc3b14a)

コメント (0)