Meta a rendu sa décision publique dans de nouvelles mises à jour, publiées dans son centre d'aide dans la soirée du 6 novembre.

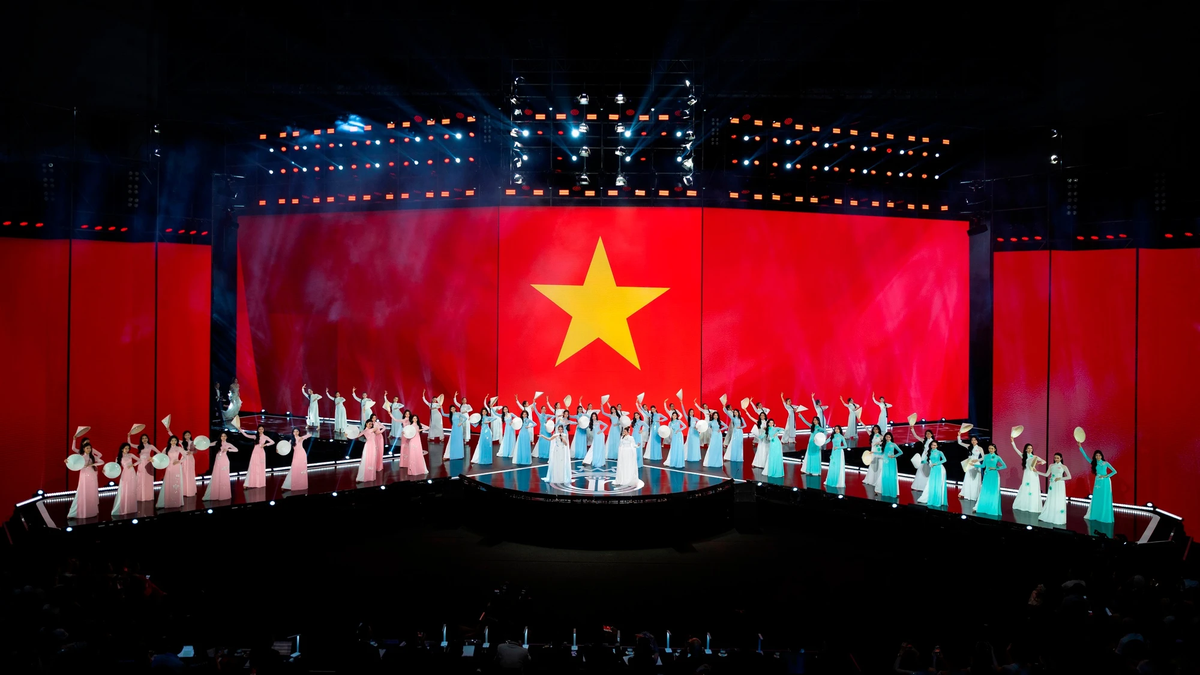

Photo : Reuters

« Alors que nous continuons à tester de nouveaux outils de création d'annonces génératives d'IA dans Ads Manager, les annonceurs qui mènent des campagnes sur le logement, l'emploi, le crédit ou les questions sociales, les élections ou la politique, ainsi que celles liées aux soins de santé, aux produits pharmaceutiques ou aux services financiers ne pourront pas actuellement utiliser ces fonctionnalités », a déclaré la société dans une note jointe à plusieurs pages expliquant le fonctionnement des outils.

« Nous pensons que cette approche nous permettra de mieux comprendre les risques potentiels et de mettre en place des garanties appropriées pour l’utilisation de l’IA générative dans les publicités liées à des sujets potentiellement sensibles dans les secteurs réglementés », a déclaré Meta.

La mise à jour de la politique intervient un mois après que Meta a annoncé qu'elle commençait à étendre l'accès des annonceurs aux outils publicitaires basés sur l'IA pour créer des arrière-plans, des ajustements d'image et des variantes d'annonces qui répondent à de simples invites de texte.

Ces outils seront initialement disponibles pour un petit groupe d’annonceurs à partir du printemps. À l'époque, Meta avait déclaré qu'elle était en bonne voie pour être déployée auprès de tous les annonceurs du monde entier l'année prochaine.

Meta et d'autres entreprises technologiques se sont précipitées pour lancer des produits publicitaires IA innovants et des assistants virtuels ces derniers mois en réponse au mouvement mondial de l'IA.

Jusqu’à présent, les entreprises ont révélé peu de choses sur les protections de sécurité qu’elles prévoient d’imposer à ces systèmes, ce qui fait de la décision de Meta sur la publicité politique l’une des décisions politiques les plus importantes en matière d’IA dans le domaine à ce jour.

Hoang Ton (selon Reuters)

Source

![[Photo] Le président de l'Assemblée nationale, Tran Thanh Man, assiste au congrès du Parti de la Commission de la culture et des affaires sociales](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/11/f5ed02beb9404bca998a08b34ef255a6)

![[Photo] Découvrez les magnifiques paysages de Wulingyuan à Zhangjiajie, en Chine](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/11/1207318fb0b0467fb0f5ea4869da5517)

![[Photo] Le président de l'Assemblée nationale travaille avec les dirigeants de la ville de Can Tho, des provinces de Hau Giang et de Soc Trang](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/11/c40b0aead4bd43c8ba1f48d2de40720e)

Comment (0)