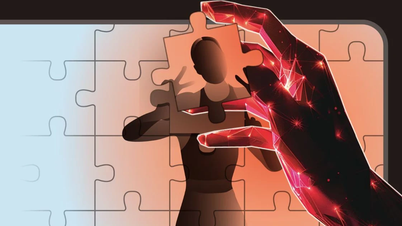

Visionnées des millions de fois sur les plateformes en ligne, ces images sont des deepfakes créées à l'aide de l'intelligence artificielle. Si vous regardez attentivement, vous pouvez voir des indices révélateurs comme des doigts étrangement courbés ou des yeux qui scintillent d'une lumière surnaturelle.

L’indignation suscitée par ces images deepfake est cependant réelle.

Les photos de la guerre entre Israël et le Hamas illustrent de manière vivante et douloureuse les dangers de l’IA en tant qu’outil de propagande, utilisé pour créer des images réalistes.

Depuis le début des combats le mois dernier, des photos manipulées numériquement circulant sur les réseaux sociaux ont été utilisées pour faire de fausses déclarations sur la responsabilité des victimes ou pour tromper les gens sur des atrocités qui n’ont jamais eu lieu.

Un Palestinien ramasse ses affaires dans les décombres à Gaza. AP Photo

Les progrès technologiques se produisent de plus en plus fréquemment et avec peu de surveillance. Cela rend clair le risque que l’IA devienne une autre forme d’arme et offre un premier aperçu de ce qui se passera lors des futurs conflits, élections et autres événements majeurs.

« Les choses vont empirer avant de s’améliorer », a déclaré Jean-Claude Goldenstein, PDG de CREOpoint, une société technologique basée à San Francisco et à Paris qui utilise l’IA pour évaluer la validité des plaintes en ligne.

Son entreprise a compilé une base de données des images deepfake les plus virales provenant de Gaza. « Images, vidéo et audio : avec l’IA créative, ce sera un pas en avant comme vous n’en avez jamais vu auparavant », a-t-il déclaré.

Imran Ahmed, PDG du Center for Countering Digital Hate, une organisation à but non lucratif qui traque la désinformation liée à la guerre, a déclaré que les propagandistes qui créent de telles images sont habiles à cibler les pulsions et les angoisses les plus profondes des gens.

Plus l’image est effrayante, plus les utilisateurs sont susceptibles de s’en souvenir et de la partager, propageant ainsi par inadvertance davantage de désinformation. Des contenus similaires, générés par l’IA, ont commencé à devenir viraux après le conflit entre la Russie et l’Ukraine.

Chaque nouveau conflit ou saison électorale présente des opportunités de désinformation. De nombreux experts en intelligence artificielle et politologues mettent en garde contre les risques qui pourraient survenir l’année prochaine, lorsque plusieurs pays organiseront des élections majeures, notamment aux États-Unis, en Inde, au Pakistan, en Ukraine, en Indonésie et au Mexique.

Le risque que l’IA et les médias sociaux soient utilisés pour diffuser des mensonges aux électeurs américains a alarmé les législateurs des deux partis à Washington. Lors d'une récente audition sur les dangers de la technologie deepfake, le représentant américain Gerry Connolly, un démocrate de Virginie, a déclaré que les États-Unis devaient investir dans le financement du développement d'outils d'IA conçus pour contrer d'autres IA.

Pour répondre efficacement aux défis politiques et sociaux posés par la désinformation générée par l’IA, il faudra à la fois une meilleure technologie et une meilleure réglementation, a déclaré David Doermann, professeur à l’Université de Buffalo.

Mai Anh (selon AP)

Source

![[Photo] Le président de l'Assemblée nationale, Tran Thanh Man, assiste au congrès du Parti de la Commission de la culture et des affaires sociales](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/11/f5ed02beb9404bca998a08b34ef255a6)

![[Photo] Le président de l'Assemblée nationale travaille avec les dirigeants de la ville de Can Tho, des provinces de Hau Giang et de Soc Trang](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/11/c40b0aead4bd43c8ba1f48d2de40720e)

![[Photo] Découvrez les magnifiques paysages de Wulingyuan à Zhangjiajie, en Chine](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/11/1207318fb0b0467fb0f5ea4869da5517)

Comment (0)