El gigante tecnológico está bajo creciente presión en Estados Unidos y Europa por las acusaciones de que sus aplicaciones son adictivas y causan problemas de salud mental entre los jóvenes.

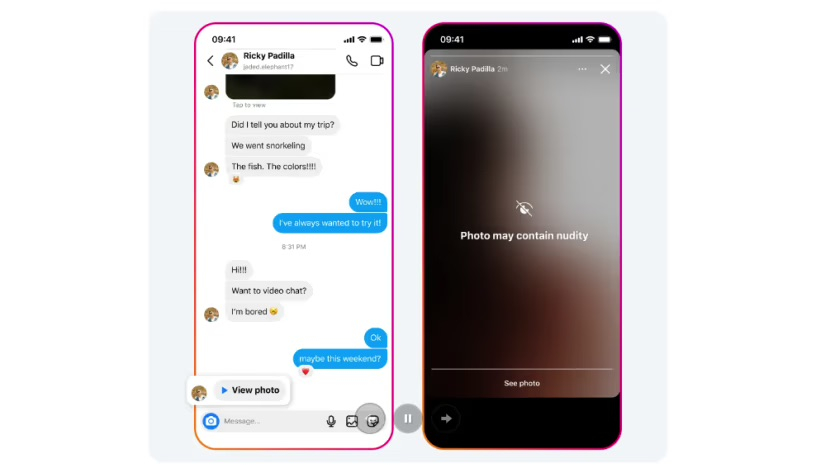

Cuando alguien recibe un mensaje de Instagram que contiene una foto de un desnudo, la imagen se difuminará automáticamente debajo de la pantalla de advertencia. Foto: Meta

La función de protección de mensajes directos de Instagram utilizará el aprendizaje automático del dispositivo para analizar si las imágenes enviadas a través del servicio contienen desnudez, dijo Meta.

Esta función estará habilitada de forma predeterminada para los usuarios menores de 18 años y Meta notificará a los adultos para alentarlos a habilitarla.

“Dado que las imágenes se analizan en el propio dispositivo, la protección contra la desnudez también funcionará en chats cifrados de extremo a extremo, donde Meta no tendrá acceso a estas imágenes, a menos que alguien decida reportarlas”, dijo la compañía.

A diferencia de las aplicaciones Messenger y WhatsApp de Meta, los mensajes directos de Instagram no están encriptados, pero la compañía dice que planea implementar el cifrado en el servicio para compartir fotografías.

Meta también dijo que está desarrollando tecnología para ayudar a identificar cuentas que puedan estar involucradas en estafas de sextorsión y está probando habilitar nuevas notificaciones para los usuarios que puedan haber interactuado con esas cuentas.

En enero, Meta dijo que ocultaría más contenido a los adolescentes en Facebook e Instagram, y agregó que esto dificultaría que los jóvenes accedan a contenido sensible como suicidio, autolesiones y trastornos alimentarios.

Treinta y tres estados de EE. UU., incluidos California y Nueva York, demandaron a Meta en octubre de 2023, alegando que la empresa tecnológica mintió repetidamente al público sobre los peligros de su plataforma. La Comisión Europea también ha pedido a Meta que proteja a los niños de contenidos ilegales y dañinos.

Mai Anh (según CNA)

[anuncio_2]

Fuente

![[Foto] El presidente Luong Cuong entrega la insignia de afiliación al Partido por 40 años al jefe de la Oficina del Presidente Le Khanh Hai.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/19/a22bc55dd7bf4a2ab7e3958d32282c15)

![[Foto] Primer plano del puente Tang Long, ciudad de Thu Duc, después de reparar los baches.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/19/086736d9d11f43198f5bd8d78df9bd41)

![[Foto] Panorama de la ceremonia de apertura del 43º Campeonato Nacional de Tenis de Mesa del periódico Nhan Dan](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/19/5e22950340b941309280448198bcf1d9)

![[Foto] El Secretario General To Lam asiste a la conferencia para revisar 10 años de implementación de la Directiva No. 05 del Politburó y evaluar los resultados de la implementación de la Regulación No. 09 del Comité Central del Partido de Seguridad Pública.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/19/2f44458c655a4403acd7929dbbfa5039)

![[Foto] El primer ministro Pham Minh Chinh inspecciona el progreso del proyecto del Centro Nacional de Exposiciones y Ferias.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/19/35189ac8807140d897ad2b7d2583fbae)

![[VÍDEO] - Aumentando el valor de los productos OCOP de Quang Nam a través de conexiones comerciales](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/5/17/5be5b5fff1f14914986fad159097a677)

Kommentar (0)