Los "padrinos de la IA", ganadores del premio VinFuture 2024, creen que los científicos deben garantizar que los escenarios de IA no amenacen la supervivencia de la humanidad.

Hoy, 7 de diciembre, los ganadores del Premio VinFuture 2024 interactuaron con estudiantes y jóvenes científicos de la Universidad VinUni sobre la investigación científica y las perspectivas futuras de los campos en los que se desempeñan. Aquí, los ganadores de los premios principales, científicos brillantes cuyo trabajo innovador sentó las bases para la revolución de la IA actual, hablaron sobre los increíbles avances en IA.

El profesor Yann LeCun (centro) y el profesor Yoshua Bengio (portada izquierda) en la sesión de intercambio

"Nos sentimos como si hubiéramos saltado 10 años hacia el futuro".

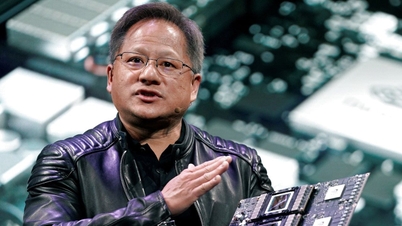

El profesor Geoffrey Hinton, de la Universidad de Toronto (Canadá), no viajó a Vietnam para recibir el premio y participó en el intercambio vía video . Él, junto con el profesor Yann LeCun y el profesor Yoshua Bengio, recibieron el Premio Turing (un premio considerado el Premio Nobel en informática) en 2018, y todos ellos son llamados "padrinos de la IA" por los medios internacionales. Ahora, los tres continúan siendo honrados por VinFuture 2024 en el premio principal junto con otros dos científicos, el profesor Fei Fei Li (EE. UU.) y el Sr. Jensen Huang (CEO de NVIDIA).

Según el profesor Hinton, el reciente auge de la IA es el resultado de tres factores. La primera es la investigación destinada a desarrollar métodos más eficientes que permitan que las redes neuronales aprendan, algo que él, el profesor Yoshua, el profesor Yann y muchos otros han hecho. Además, está la potencia de cálculo extremadamente rápida de las unidades de procesamiento gráfico (GPU) y la enorme cantidad de datos que podemos recopilar.

El profesor Geoffrey Hinton comparte vía video

Un aspecto destacado de este premio (VinFuture 2024) es el reconocimiento a la labor del Sr. Jensen Huang, pionero en la creación de placas GPU útiles para la IA. La combinación de la placa GPU de Jensen Huang y los conjuntos de datos del profesor Fei Fei Li desempeñó un papel fundamental en el desarrollo moderno de la IA. Es excelente que su trabajo sea reconocido junto con el de quienes trabajan en algoritmos de redes neuronales, afirmó el profesor Hinton.

Descubrimos que, al usar GPU para entrenar redes neuronales, estas eran 30 veces más rápidas. Fue un salto cualitativo. Era como si la velocidad de computación se hubiera adelantado 10 años a su tiempo. De repente, estábamos 10 años por delante del futuro en términos de velocidad de computación. ¡Fue un punto de inflexión para la IA, fue increíble! dijo el profesor Hinton.

Hoy en día, los científicos continúan buscando comprender mejor las conexiones dentro de las redes neuronales. Esto ayudaría a los científicos a crear un tipo de inteligencia artificial más similar a la inteligencia humana, e incluso podría explicar la intuición. El enfoque lógico tradicional nunca hizo eso.

"Estoy empezando a tener miedo de la IA"

El profesor Hinton comentó que las grandes redes neuronales actuales tienen intuición de manera similar a la de los humanos. Desde el año pasado, le preocupa que la IA pueda llegar a ser tan inteligente como los humanos en tan solo cinco a veinte años. Fue entonces cuando empecé a tener miedo de la IA. Detener el desarrollo no es una opción. Así que la única opción es intentar averiguar cómo garantizar su seguridad cuando se vuelva más inteligente que nosotros —compartió el profesor Hinton—.

"Pero no creo que el fin del mundo sea inevitable", dice el profesor Hinton. Pero no se pueden ignorar las posibilidades, y debemos trabajar arduamente para prevenirlas. Esperemos que los estudiantes más talentosos opten por estudiar seguridad en IA, abordando una amplia gama de amenazas, desde amenazas a largo plazo, como la toma de control de la IA, hasta amenazas a corto plazo, como la ciberdelincuencia.

Profesor Yoshua Bengio y Profesor Yann LeCun

El profesor Yann Lecun dijo que también le preocupa el riesgo de que, cuando la IA sea tan inteligente como los humanos, domine a los humanos. Sin embargo, la respuesta actual es no. Podemos perder jugando al ajedrez con un juguete pequeño que cuesta 30 euros. ¿Es peligroso? La respuesta es no. La IA solo se vuelve peligrosa cuando creamos motivación (control humano) para ella. Pero, por ahora, la IA solo tiene conocimiento, no motivación —dijo el profesor Yann—.

Según el profesor Yann, crear una IA que sirva activamente a los humanos es solo un problema técnico. Porque la IA es inteligente, pensar que la IA dominará a los humanos es un prejuicio, porque la realidad demuestra que en la sociedad ha habido mucha gente inteligente pero no ha dominado el mundo . La IA sigue siendo una herramienta, el problema está en los humanos, no en la IA.

Según el profesor Yoshua Bengio, no podemos ser subjetivos, sólo un pequeño problema puede afectar la supervivencia de la humanidad. Los humanos pueden motivar a las máquinas. Por ejemplo, alguien quiere convertir la máquina en un humano, haciendo que la máquina tenga la necesidad de "sobrevivir", queremos apagar la máquina pero no se apaga. “Por supuesto que tenemos que asegurarnos de que ese escenario no ocurra”, dijo el profesor Bengio.

[anuncio_2]

Fuente: https://thanhnien.vn/vinfuture-award-2024-khong-de-ai-de-doa-su-ton-vong-cua-nhan-loai-185241207195331155.htm

![[Foto] El Secretario General To Lam visita una exposición de logros en el desarrollo económico privado.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/18/1809dc545f214a86911fe2d2d0fde2e8)

![[Foto] Más de 17.000 candidatos participan en la Prueba de Evaluación de Competencias SPT 2025 de la Universidad Nacional de Educación de Hanoi](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/17/e538d9a1636c407cbb211b314e6303fd)

![[Foto] Conferencia nacional para difundir e implementar la Resolución No. 66-NQ/TW y la Resolución No. 68-NQ/TW del Politburó](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/18/adf666b9303a4213998b395b05234b6a)

![[Foto] El primer ministro Pham Minh Chinh preside una reunión sobre desarrollo de ciencia y tecnología.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/17/ae80dd74c384439789b12013c738a045)

Kommentar (0)