Wie funktionieren gefälschte KI-Bilder?

KI ist heute überall – sogar im Krieg. Die Anwendungen künstlicher Intelligenz haben sich in diesem Jahr stark verbessert und fast jeder kann mithilfe von KI-Generatoren Bilder erstellen, die zumindest auf den ersten Blick realistisch aussehen.

Ein von KI generiertes gefälschtes Foto des Krieges im Gazastreifen.

Hierzu müssen die Nutzer Tools wie Midjourney oder Dall-E lediglich ein paar Hinweise, wie Spezifikationen und Informationen geben. KI-Tools wandeln dann Text- oder sogar Sprachanweisungen in Bilder um.

Dieser Bildgenerierungsprozess basiert auf dem sogenannten maschinellen Lernen. Wenn der Ersteller beispielsweise darum bittet, einen 70-jährigen Mann beim Fahrradfahren abzubilden, durchsucht er seine Datenbank, um die Begriffe mit dem Bild abzugleichen.

Basierend auf den verfügbaren Informationen generiert der KI-Algorithmus ein Bild des älteren Radfahrers. Dank ständig wachsendem Input und technischen Updates haben sich diese Tools dramatisch verbessert und lernen ständig dazu.

All dies wird auf Bilder angewendet, die mit dem Konflikt im Nahen Osten in Zusammenhang stehen. In einem Konflikt, in dem „die Emotionen sehr hochkochen“, haben Fehlinformationen, auch solche, die über KI-Bilder verbreitet werden, enorme Auswirkungen, sagte der KI-Experte Hany Farid.

Farid, Professor für digitale Analytik an der University of California in Berkeley, sagte, erbitterte Kämpfe seien der perfekte Nährboden für die Erstellung und Verbreitung gefälschter Inhalte sowie für das Schüren von Emotionen.

KI-Bilder des Israel-Hamas-Krieges

Mithilfe künstlicher Intelligenz erstellte Bilder und Videos haben die Desinformation im Zusammenhang mit dem Krieg in der Ukraine angeheizt, und dieser Trend setzt sich auch im Krieg zwischen Israel und der Hamas fort.

Experten zufolge lassen sich die in den sozialen Medien kursierenden KI-Bilder zum Thema Krieg häufig in zwei Kategorien einteilen. Eines, das sich auf das Leid der Menschen konzentriert und Empathie hervorruft. Die andere ist eine künstliche Intelligenz, die Ereignisse übertreibt und dadurch Konflikte anstachelt und die Gewalt eskalieren lässt.

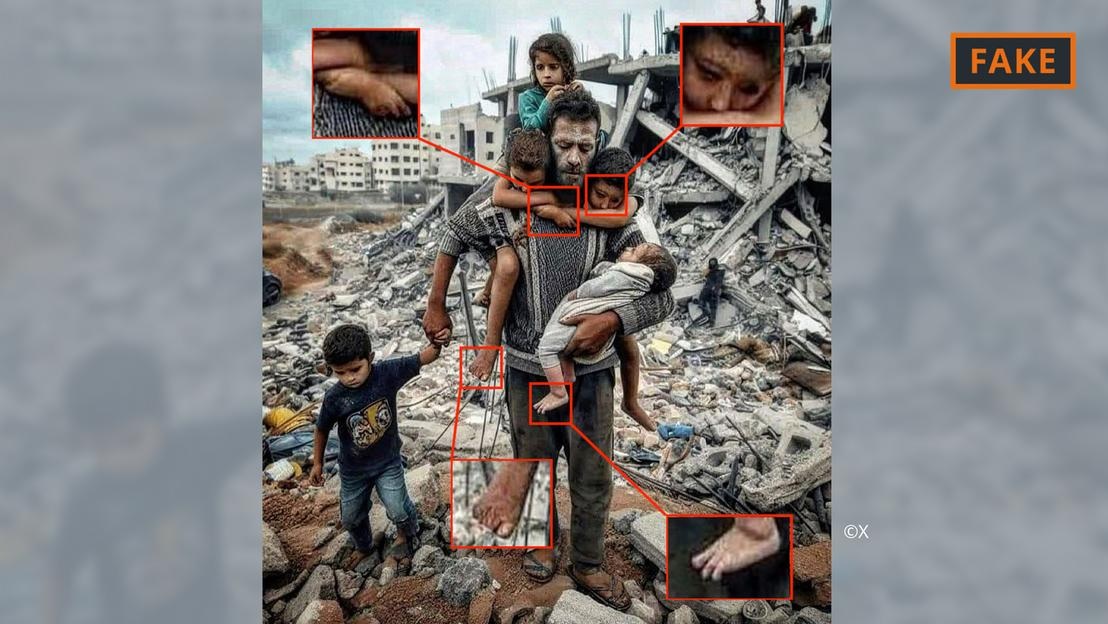

KI-generiertes gefälschtes Foto von Vater und Kind in den Trümmern im Gazastreifen.

Zur ersten Kategorie gehört beispielsweise das oben stehende Foto eines Vaters mit seinen fünf Kindern vor einem Trümmerhaufen. Es wurde mehrfach auf X (früher Twitter) und Instagram geteilt und hunderttausendfach angesehen.

Dieses Bild wurde von der Community, zumindest auf X, als Fälschung gekennzeichnet. Es ist an verschiedenen Fehlern und Inkonsistenzen zu erkennen, die häufig in KI-Bildern auftreten (siehe Bild oben).

Ähnliche Anomalien sind auch in dem gefälschten KI-Bild zu sehen, das unten auf X viral ging und angeblich eine palästinensische Familie zeigt, die gemeinsam auf den Ruinen isst.

KI-generiertes gefälschtes Foto einer palästinensischen Partei.

Ein weiteres Bild, das Soldaten zeigt, die israelische Flaggen schwenken, während sie durch eine Siedlung voller ausgebombter Häuser marschieren, fällt in die zweite Kategorie und soll Hass und Gewalt schüren.

Woher kommen solche KI-Bilder?

Die meisten von KI generierten Konfliktbilder werden auf Social-Media-Plattformen veröffentlicht, sind aber auch auf zahlreichen anderen Plattformen und Organisationen und sogar auf einigen Nachrichtenseiten verfügbar.

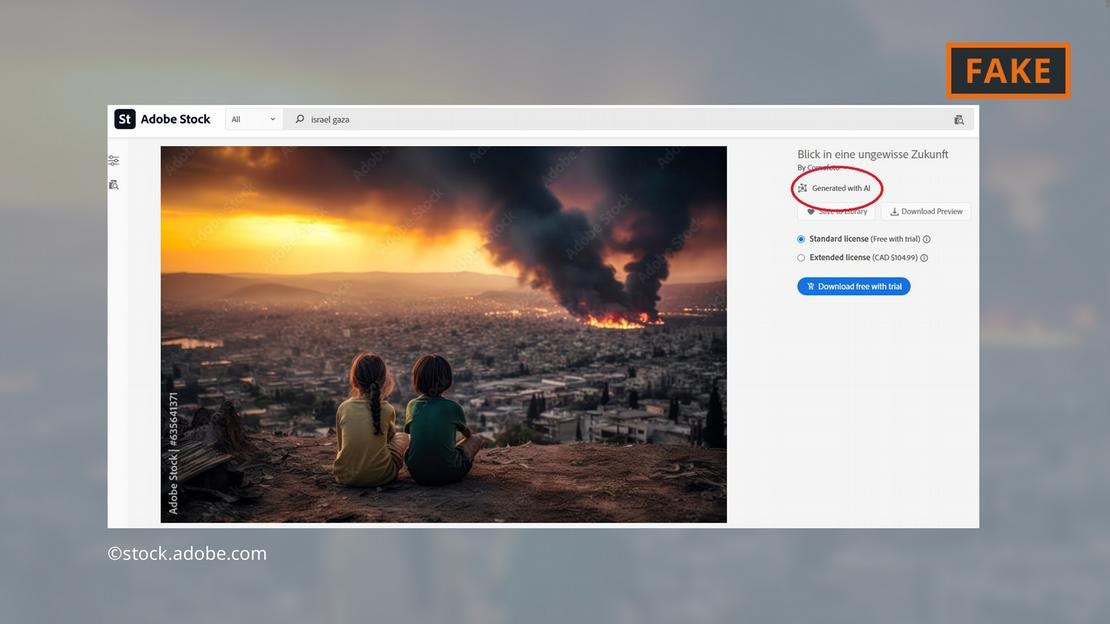

Der Softwarekonzern Adobe sorgt für Aufsehen, indem er sein Stockfoto-Angebot bis Ende 2022 um KI-generierte Bilder erweitert. In der Datenbank werden sie entsprechend gekennzeichnet.

Adobe bietet mittlerweile auch KI-Bilder des Nahost-Krieges zum Verkauf an – etwa Explosionen, protestierende Menschen oder Rauchschwaden hinter der Al-Aqsa-Moschee.

Adobe bietet KI-generierte Bilder der Kämpfe im Gazastreifen an.

Kritiker empfanden dies als beunruhigend, da einige Websites die Bilder weiterhin verwendeten, ohne sie als KI-generiert zu kennzeichnen. Beispielsweise erschien das obige Bild auf der Seite „Newsbreak“, ohne dass ein Hinweis darauf zu sehen war, dass es mithilfe von KI erstellt wurde.

Sogar der Wissenschaftliche Dienst des Europäischen Parlaments, der wissenschaftliche Arm des Europäischen Parlaments, illustrierte ein Online-Dokument zum Nahostkonflikt mit einem KI-Bild aus der Adobe-Datenbank – ohne es als KI-generiert zu kennzeichnen.

Das European Digital Media Observatory rät Journalisten und Medienschaffenden dringend, bei der Verwendung von KI-Bildern äußerst vorsichtig zu sein und rät von deren Einsatz ab, insbesondere bei der Berichterstattung über reale Ereignisse wie den Krieg im Gazastreifen.

Wie gefährlich sind KI-Bilder?

Die viralen KI-Inhalte und Bilder verursachen bei den Benutzern ein ungutes Gefühl angesichts von allem, was ihnen online begegnet. „Wenn wir in eine Welt eintreten, in der Bilder, Töne und Videos manipuliert werden können, wird alles verdächtig. Man verliert den Glauben an alles, auch an die Wahrheit“, erklärt Farid, Forscher an der UC Berkeley.

Genau das ist im folgenden Fall passiert: Ein Bild der angeblich verkohlten Leiche eines israelischen Babys wurde vom israelischen Premierminister Benjamin Netanjahu und mehreren anderen Politikern in den sozialen Medien geteilt.

Der antiisraelische Influencer Jackson Hinkle behauptete später, das Bild sei mithilfe künstlicher Intelligenz erstellt worden. Hinkles Aussage wurde in den sozialen Medien mehr als 20 Millionen Mal angesehen und löste dort eine hitzige Debatte aus.

Letztendlich erklärten zahlreiche Organisationen und Überprüfungstools das Bild für echt und Hinkles Behauptung für falsch. Es gibt jedoch offensichtlich kein Tool, mit dem Benutzer ihr verlorenes Vertrauen einfach zurückgewinnen können!

Hoang Hai (laut DW)

[Anzeige_2]

Quelle

![[Foto] Der Vorsitzende der Nationalversammlung, Tran Thanh Man, leitet die Sitzung des Unterausschusses für Dokumente des ersten Parteitags der Nationalversammlung](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/72b19a73d94a4affab411fd8c87f4f8d)

![[Foto] Generalsekretär beendet Besuch in Aserbaidschan und bricht zu Besuch in die Russische Föderation auf](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/7a135ad280314b66917ad278ce0e26fa)

![[Foto] Premierminister Pham Minh Chinh trifft sich mit dem Policy Advisory Council on Private Economic Development](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/387da60b85cc489ab2aed8442fc3b14a)

![[Foto] Präsident Luong Cuong präsentiert die Entscheidung zur Ernennung des stellvertretenden Leiters des Präsidialamtes](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/501f8ee192f3476ab9f7579c57b423ad)

![[Foto] Premierminister Pham Minh Chinh telefoniert mit dem singapurischen Premierminister Lawrence Wong](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/5/8/e2eab082d9bc4fc4a360b28fa0ab94de)

Kommentar (0)