كيف تعمل صور الذكاء الاصطناعي المزيفة؟

الذكاء الاصطناعي موجود في كل مكان اليوم - حتى في الحرب. لقد تحسنت تطبيقات الذكاء الاصطناعي كثيرًا هذا العام، ويمكن لأي شخص تقريبًا استخدام مولدات الذكاء الاصطناعي لإنشاء صور تبدو واقعية، على الأقل للوهلة الأولى.

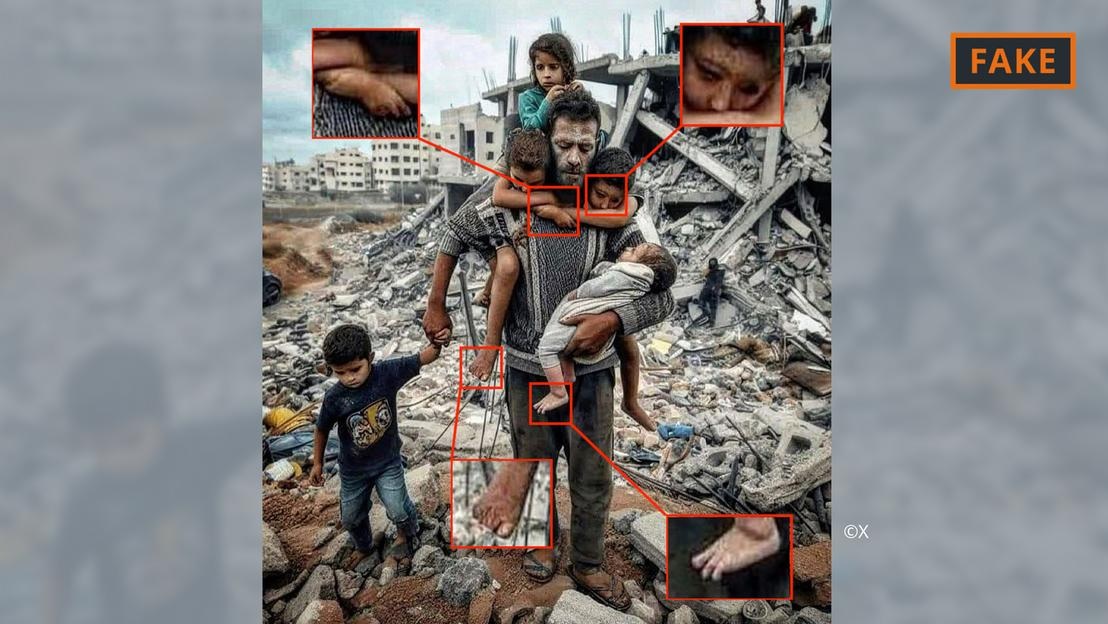

صورة مزيفة تم إنشاؤها بواسطة الذكاء الاصطناعي للحرب في غزة.

كل ما يحتاجه المستخدمون هو إعطاء أدوات مثل Midjourney أو Dall-E بعض التلميحات، بما في ذلك المواصفات والمعلومات، للقيام بذلك. ثم تقوم أدوات الذكاء الاصطناعي بتحويل النصوص، أو حتى الصوت، إلى صور.

تعتمد عملية إنشاء الصور هذه على ما يسمى بالتعلم الآلي. على سبيل المثال، إذا طلب منشئ المحتوى إظهار رجل يبلغ من العمر 70 عامًا يركب دراجة، فسوف يبحث في قاعدة البيانات الخاصة به لمطابقة المصطلحات مع الصورة.

وبناءً على المعلومات المتاحة، ستقوم خوارزمية الذكاء الاصطناعي بإنشاء صورة لراكب الدراجة المسن. بفضل المدخلات المتزايدة والتحديثات الفنية، تحسنت هذه الأدوات بشكل كبير وتتعلم باستمرار.

ويتم تطبيق كل هذا على الصور المتعلقة بالصراع في الشرق الأوسط. وفي صراع "حيث تكون المشاعر عالية للغاية"، فإن المعلومات المضللة، بما في ذلك تلك التي تنتشر من خلال صور الذكاء الاصطناعي، لها تأثير كبير، كما يقول خبير الذكاء الاصطناعي هاني فريد.

وقال فريد، أستاذ التحليلات الرقمية في جامعة كاليفورنيا في بيركلي، إن المعارك الشرسة تشكل أرضا خصبة مثالية لإنشاء ونشر المحتوى المزيف، فضلا عن إثارة المشاعر.

صور الذكاء الاصطناعي للحرب بين إسرائيل وحماس

وقد ساهمت الصور ومقاطع الفيديو التي تم إنشاؤها بمساعدة الذكاء الاصطناعي في تعزيز المعلومات المضللة المتعلقة بالحرب في أوكرانيا، وهذا ما يستمر في الحدوث في الحرب بين إسرائيل وحماس.

وبحسب الخبراء، فإن صور الذكاء الاصطناعي المتداولة على وسائل التواصل الاجتماعي حول الحرب تنقسم في الغالب إلى فئتين. الذي يركز على معاناة الناس ويثير التعاطف. والنوع الآخر هو الذكاء الاصطناعي المزيف الذي يبالغ في الأحداث، مما يؤدي إلى إثارة الصراع وتصعيد العنف.

صورة مزيفة تم إنشاؤها بواسطة الذكاء الاصطناعي لأب وطفله وسط الأنقاض في غزة.

على سبيل المثال، تتضمن الفئة الأولى الصورة أعلاه لأب مع أطفاله الخمسة أمام كومة من الأنقاض. وقد تم مشاركته عدة مرات على X (المعروف سابقًا باسم Twitter) و Instagram، وتمت مشاهدته مئات الآلاف من المرات.

لقد تم وضع علامة على هذه الصورة من قبل المجتمع، على الأقل على X، باعتبارها مزيفة. يمكن التعرف عليه من خلال الأخطاء والتناقضات المختلفة الموجودة عادة في صور الذكاء الاصطناعي (انظر الصورة أعلاه).

ويمكن رؤية شذوذ مماثل أيضًا في صورة الذكاء الاصطناعي المزيفة التي انتشرت على موقع X أدناه، والتي تزعم أنها تُظهر عائلة فلسطينية تتناول الطعام معًا على الأنقاض.

صورة مزيفة تم إنشاؤها بواسطة الذكاء الاصطناعي لحزب فلسطيني.

وفي الوقت نفسه، هناك صورة أخرى تظهر جنوداً يلوحون بالأعلام الإسرائيلية أثناء سيرهم عبر مستوطنة مليئة بالمنازل المدمرة، وتندرج ضمن الفئة الثانية، وهي تهدف إلى إثارة الكراهية والعنف.

من أين تأتي مثل هذه الصور الذكاء الاصطناعي؟

يتم نشر معظم صور الصراع التي تم إنشاؤها بواسطة الذكاء الاصطناعي على منصات التواصل الاجتماعي، ولكنها متاحة أيضًا على عدد من المنصات والمنظمات الأخرى، وحتى على بعض مواقع الأخبار.

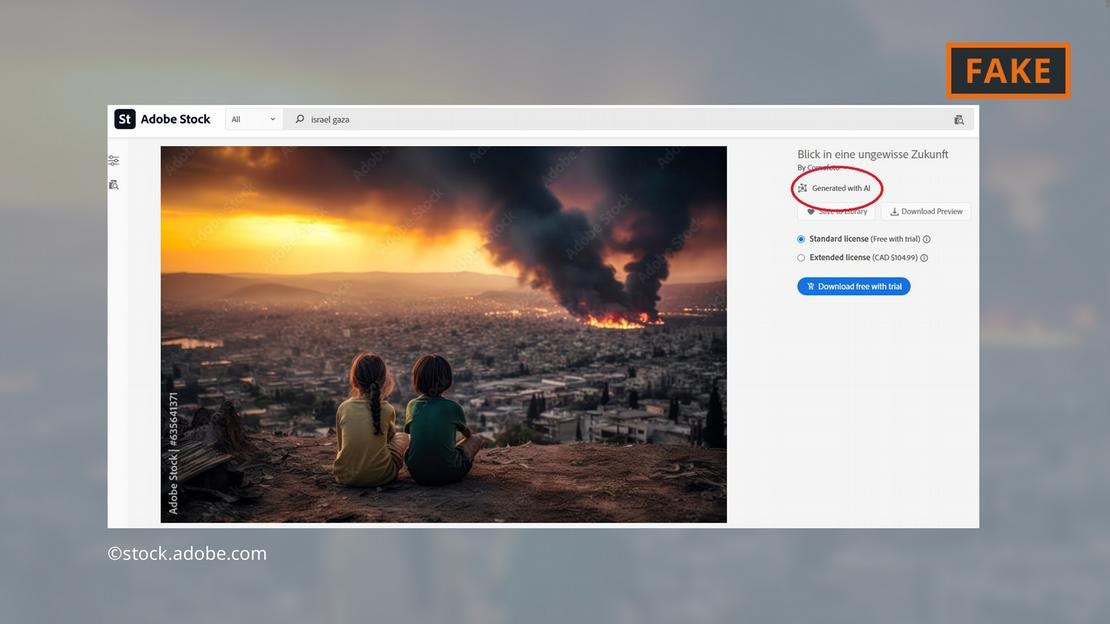

أحدثت شركة البرمجيات Adobe ضجة كبيرة من خلال إضافة صور تم إنشاؤها بواسطة الذكاء الاصطناعي إلى مجموعة صورها المخزنة بحلول نهاية عام 2022. ويتم تصنيفها وفقًا لذلك في قاعدة البيانات.

وتقدم شركة Adobe الآن أيضًا صورًا للذكاء الاصطناعي للحرب في الشرق الأوسط للبيع - مثل الانفجارات، أو الأشخاص الذين يحتجون، أو أعمدة الدخان خلف المسجد الأقصى.

تقدم شركة Adobe صورًا تم إنشاؤها بواسطة الذكاء الاصطناعي للقتال في غزة.

ووجد النقاد هذا الأمر مزعجًا لأن بعض المواقع استمرت في استخدام الصور دون تصنيفها على أنها من صنع الذكاء الاصطناعي. على سبيل المثال، ظهرت الصورة أعلاه على صفحة "Newsbreak" دون أي إشارة إلى أنها تم إنشاؤها باستخدام الذكاء الاصطناعي.

حتى أن خدمة البحوث البرلمانية الأوروبية، وهي الذراع العلمية للبرلمان الأوروبي، قامت بتوضيح وثيقة عبر الإنترنت حول الصراع في الشرق الأوسط باستخدام صورة ذكاء اصطناعي من قاعدة بيانات Adobe - دون تصنيفها على أنها من صنع الذكاء الاصطناعي.

يحث المرصد الأوروبي للإعلام الرقمي الصحفيين والمحترفين الإعلاميين على توخي الحذر الشديد عند استخدام صور الذكاء الاصطناعي، وينصح بعدم استخدامها، خاصة عند تغطية الأحداث الحقيقية مثل الحرب في غزة.

ما مدى خطورة صور الذكاء الاصطناعي؟

إن المحتوى والصور المرتبطة بالذكاء الاصطناعي الفيروسية تجعل المستخدمين يشعرون بعدم الارتياح تجاه كل ما يواجهونه عبر الإنترنت. "إذا دخلنا هذا العالم حيث يُمكن التلاعب بالصور والأصوات والفيديوهات، يُصبح كل شيء مُريبًا. لذا نفقد الثقة بكل شيء، حتى الحقيقة"، يوضح الباحث فريد من جامعة كاليفورنيا، بيركلي.

وهذا ما حدث بالضبط في الحالة التالية: قام رئيس الوزراء الإسرائيلي بنيامين نتنياهو وعدد من السياسيين الآخرين بمشاركة صورة لما قيل إنها جثة متفحمة لطفل إسرائيلي على وسائل التواصل الاجتماعي.

وفي وقت لاحق، زعم أحد المؤثرين المعادين لإسرائيل، جاكسون هينكل، أن الصورة تم إنشاؤها باستخدام الذكاء الاصطناعي. حظيت تصريحات هينكل بأكثر من 20 مليون مشاهدة على وسائل التواصل الاجتماعي، وأثارت جدلاً حاداً على المنصة.

وفي نهاية المطاف، أعلنت العديد من المنظمات وأدوات التحقق أن الصورة حقيقية وأن ادعاء هينكل كاذب. ومع ذلك، فمن الواضح أنه لا توجد أداة يمكنها مساعدة المستخدمين على استعادة ثقتهم المفقودة بسهولة!

هوانغ هاي (وفقا لـ DW)

[إعلان 2]

مصدر

![[صورة] الأمين العام يختتم زيارته إلى أذربيجان ويتوجه إلى روسيا الاتحادية](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/7a135ad280314b66917ad278ce0e26fa)

![[صورة] رئيس الوزراء فام مينه تشينه يلتقي مع المجلس الاستشاري للسياسات بشأن التنمية الاقتصادية الخاصة](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/387da60b85cc489ab2aed8442fc3b14a)

![[صورة] الأمين العام تو لام يبدأ زيارة رسمية إلى روسيا ويحضر الذكرى الثمانين للنصر على الفاشية](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/5d2566d7f67d4a1e9b88bc677831ec9d)

![[صورة] الرئيس لونغ كونغ يقدم قرار تعيين نائب رئيس مكتب الرئيس](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/501f8ee192f3476ab9f7579c57b423ad)

![[صورة] رئيس الجمعية الوطنية تران ثانه مان يترأس اجتماع اللجنة الفرعية للوثائق في المؤتمر الوطني الأول للحزب](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/8/72b19a73d94a4affab411fd8c87f4f8d)

![[صورة] رئيس الوزراء فام مينه تشينه يتحدث عبر الهاتف مع رئيس الوزراء السنغافوري لورانس وونغ](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/5/8/e2eab082d9bc4fc4a360b28fa0ab94de)

تعليق (0)